竹内研究室の研究内容

本講座では,学習理論とその応用を中心として情報数理分野の研究

を行っている.

機械学習の技術には様々な側面があるが,その情報量的側面に着目

した研究を行っている.特に,記述長最小原理(Minimum

Description Length = MDL),確率的コンプレキシティ,情報幾何

などの理論と学習技術の実応用を手がけている.

記述長最小原理,確率的コンプレキシティ

統計学や学習理論の重要な基本問題に,モデル選択がある.

これは,複数の統計モデルの中から,

与えられたデータに相応しいモデルを選ぶ問題である.

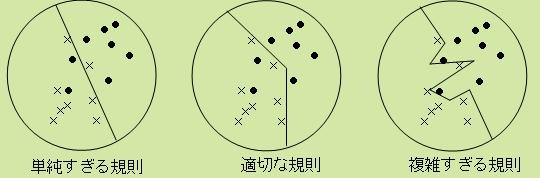

例えば下図では,○と×をうまく分類するように線を引く

問題を表している.ここでは折れ線による領域の分割をモデル

(分類規則)と呼ぶ.

左は例外を多く許した単純すぎるモデルである.

右は複雑すぎるモデルで,ノイズに過敏で新たなデータに対する予測力が低

い.中央が適切なモデルである.

これに対して,

全記述長=モデル記述長+データ記述長が最小になるモ

デルを選ぶMDL基準が情報理論の分野から提唱されている[Rissanen 1978].

MDL基準に従えば,適切な規則が選択され,

未知データに対して高い予測精度が得られる.

これはデータ圧縮と関連した理論体系をもち,

多くの理論的/実験的研究成果が知られている.

さらにMDL原理の考え方を徹底した

確率的コンプレキシティ(Stochastic Complexity=SC)の

概念が提唱されている.

これは「モデルを利用してデータを

出来るだけ短く記述するさいの符号長」であり,

SCを追求することで性能のよい学習アルゴリズムや精密なモデル選

択基準を得ることが出来る.

本研究では,様々な統計モデルについて,主にBayes混合の手法を用い

これらの問題にアプローチする.

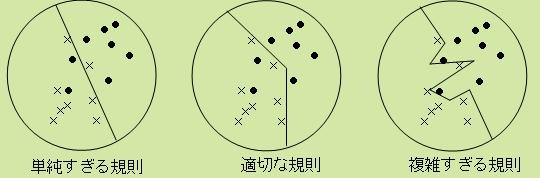

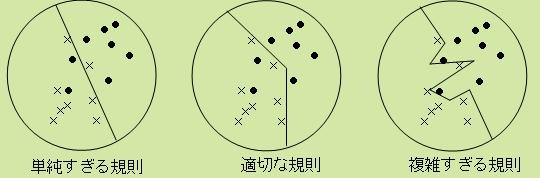

左は例外を多く許した単純すぎるモデルである.

右は複雑すぎるモデルで,ノイズに過敏で新たなデータに対する予測力が低

い.中央が適切なモデルである.

これに対して,

全記述長=モデル記述長+データ記述長が最小になるモ

デルを選ぶMDL基準が情報理論の分野から提唱されている[Rissanen 1978].

MDL基準に従えば,適切な規則が選択され,

未知データに対して高い予測精度が得られる.

これはデータ圧縮と関連した理論体系をもち,

多くの理論的/実験的研究成果が知られている.

さらにMDL原理の考え方を徹底した

確率的コンプレキシティ(Stochastic Complexity=SC)の

概念が提唱されている.

これは「モデルを利用してデータを

出来るだけ短く記述するさいの符号長」であり,

SCを追求することで性能のよい学習アルゴリズムや精密なモデル選

択基準を得ることが出来る.

本研究では,様々な統計モデルについて,主にBayes混合の手法を用い

これらの問題にアプローチする.

情報幾何

情報幾何は,統計モデル(確率分布の集合)を多様体として捉えて

その微分幾何学的構造を考察する分野であり,

学習を含む統計的推測に対して直感的理解を与える

強力な方法論である.

我々は主にBayes混合の手法について情報幾何を用いた

研究を行ってきた.例えば,Bayes予測法の漸近的特徴の解析,

重要なJeffreys事前分布の幾何学的特徴に着目した一般化,

Markovモデルの曲率の考察などである.

今後は,これらのテーマをさらに推し進めるとともに,例えば特異

モデルなどにその対象を広げることを目指す.

理論関連論文

-

J. Takeuchi & T. Kawabata :

``Exponential Curvature of Markov Models,''

to appear,

2007 IEEE International Symposium on Information

Theory, 2007.

-

H. Matsuzoe, J. Takeuchi & S. Amari:

``Equiaffine structures on statistical manifolds and

Bayesian statistics,''

Differential Geometry and Its Applications,

vol. 24/6, pp. 567-578, December 2006.

- 川端, 竹内:

``離散定常情報源の確率構造について,''

第29回情報理論とその応用シンポジウム予稿集, 2006年11月.

- 竹内, 川端:

``

木情報源と確率的コンプレキシティ,''

第4回シャノン理論ワークショップ予稿集, 2006年9月.

-

J. Takeuchi, A. R. Barron & T. Kawabata:

``

Statistical curvature and stochastic complexity,''

Proc. of the 2nd Symposium on

Information Geometry and Its Applications,

pp. 29--36, 2006.

-

J. Takeuchi and S. Amari:

``α-Parallel Prior and Its Properties,''

IEEE transactions on Information Theory,

Vol. 51, No. 3, pp. 1011-1023, March 2005.

- J. Takeuchi, T. Kawabata, and A. R. Barron:

``

Properties of Jeffreys mixture for Markov sources,''

Proc. of the fourth Workshop on Information-Based

Induction Sciences

(IBIS2001),

pp. 327-332, 2001.

-

竹内 :

``

定常確率系列の族に関するミニマックスリグレットについて,''

第3回情報論的学習理論ワークショップ予稿集

(IBIS2000), 2000.

-

J. Takeuchi, N. Abe, & S. Amari :

``The Lob-Pass problem,''

Journal of Computer and System Sciences,

Vol. 61, No. 3, pp. 523-557, 2000.

-

J. Takeuchi & A. R. Barron :

``Asymptotically minimax regret by Bayes mixtures,''

Proc. of 1998 IEEE International Symposium on Information

Theory, 1998.

-

竹内:

``Bayes方式によるMinimax符号,''

電子情報通信学会ソサイエティ大会予稿集, October 1998.

-

A. Nakamura, J. Takeuchi, & N. Abe :

``Efficient distribution-free population learning of simple concepts,''

Annals of Mathematics and Artificial Intelligence,

23, pp. 53-82, 1998.

-

竹内:

``

確率的コンプレキシティとJeffreys混合予測戦略,''

第1回情報論的学習理論ワークショップ予稿集

(IBIS'98), pp. 9-16, 1998.

-

A. R. Barron & J. Takeuchi:

``Mixture models achieving optimal coding regret,''

Proc. of 1998 IEEE Inform. Theory Workshop, 1998.

-

J. Takeuchi & A. R. Barron:

``

Robustly minimax codes for universal data compression,''

Proc. of

the 21st Symposium on Information Theory and its Applications

(SITA'98), 1998.

- J. Takeuchi and A. R. Barron:

``

Asymptotically minimax regret for exponential families,''

Proc. of

the 20th Symposium on Information Theory and its Applications

(SITA'97), pp. 665-668, 1997.

Best papers award at SITA'97.

-

J. Takeuchi :

``Characterization of the Bayes estimator and the MDL

estimator for exponential families,''

IEEE trans. Information Theory,

Vol. 43, No. 4, pp. 1165-1174, 1997.

- 竹内,甘利:

``

α-平行事前分布とその性質,''

電子情報通信学会技術研究報告, IT26-20, pp. 61-66, 1996.

-

J. Takeuchi & T. Kawabata :

``Approximation of Bayes code for Markov sources,''

Proc. of 1995 IEEE International Symposium on Information

Theory, p.391, 1995.

-

J. Takeuchi :

``Characterization of the Bayes estimator and the MDL

estimator for exponential families,''

Proc. of 1995 IEEE International Symposium on Information

Theory (long presentation), p.228, 1995.

- 竹内,川端:

``ベイズ符号によるマルコフ情報源のためのデータ圧縮アルゴリズムについて,''

第17回情報理論とその応用シンポジウム予稿集 (SITA'94),

pp.513-516, 1994.

-

竹内 :

``

パラメータ推定問題におけるMDL原理とベイズ符号について,''

電子情報通信学会技術研究報告, IT93-122, 1994-03, pp. 13-18,1994.

March 22nd, 2007

学習応用

現在,我々の周囲はデジタルデータで溢れ,

企業や官公庁などで蓄積されるデータは膨大である.

こうしたデータを有効利用したいと思うのは自然である.

実際,

データの山から価値ある知識を発掘する技術とされる

データマイニングが産業応用を中心に盛んである.

データマイニングは様々な技術からなるが,学習はその重要な

要素を占める.

本研究室でも,

サイバーアタックなどのセキュリティインシデントを

多量の通信ログなどから検知/予測する問題,

ITSにおける交通情報の将来予測などの実応用を手がけている.

今後はさらに,自然科学データからのデータマイニング

を新たなテーマとして取り入れることを目指す.

応用関連論文

-

衛藤, 薗田, 吉岡, 井上, 竹内, 中尾:

``スペクトラム解析を用いたマルウェアの類似性検査手法の提案,''

2007年暗号と情報セキュリティシンポジウム予稿集,

to appear , 2007.

-

Fujita, Sugisaki, Hirabayashi, Takeuchi, Nakata :

``Travel time prediction using probe-car data,''

Proceedings of the 13th World Congress on Intelligent

Transport Systems, 2006.

- Takeuchi, Yamanishi:

``A Unifying Framework for Detecting Outliers and Change Points from Non-Stationary Time Series Data,''

IEEE trans. on Knowledge and Data Engineering,

Vol. 18, No. 4, pp.482-489, 2006.

-

竹内, 佐藤,力武,中尾:

``変化点検出エンジンを利用したインシデント検知システムの構築,''

2006年 暗号と情報セキュリティシンポジウム, 2006.

-

山西,竹内,丸山:

``統計的異常検出3手法,''

情報処理, 46-1,pp.34-40, 2005.

-

Yamanishi, Takeuchi, Williamas, Milne :

``On-line Unsupervised Oultlier Detection Using Finite Mixtures with Discounting Learning Algorithms,''

Data Mining and Knowleged Discovery Journal,

8 (3): 275-300, May 2004.

-

Nakata, Takeuchi :

``Mining Traffic Data from Probe-Car System for Travel Time Prediction,''

Proc. of the tenth ACM SIGKDD International Conference on

Knowledge Discovery and Data Mining , , ACM Press (KDD2004), 2004.

January 21st, 2007